ROKO

[coursera] Convolutional Neural Networks: Week 3-2 본문

[coursera] Convolutional Neural Networks: Week 3-2

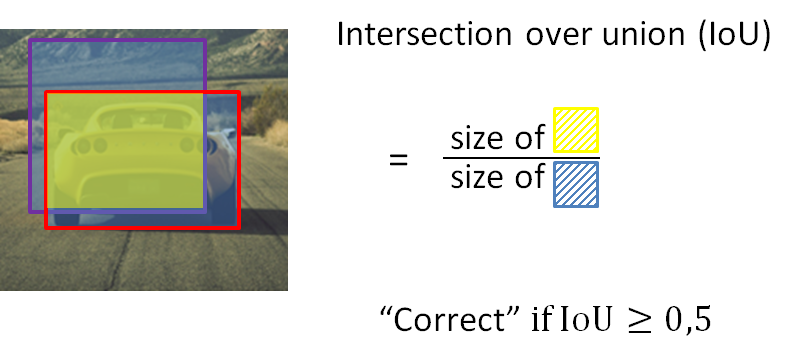

RO_KO 2024. 7. 3. 10:25Intersection of union (IoU)

IoU = intersection of area / union of area 는 bounding box를 얼마나 잘 맞췄는지에 대한 평가지표로 사용된다.

Non-max suppression (NMS)

grid cell 을 기준으로 object의 mid point를 찾을때 하나의 object에 여러 bounding box가 중복될 수 있다. 중복된 box들은 계산 복잡도를 증가하고 비효율적이기 때문에 Non-max suppresion으로 중복된 box를 제거한다. 우선 특정 \(p_c\) 값보다 적은 box들을 제거하고 나머지 box들에 NMS를 적용한다.

Anchor box

하나의 grid cell은 하나의 object밖에 예측하지 못하는건 한계점이다. 같은 girid cell에 서로 다른 object들의 midpoint가 겹쳐있을수도 있기 때문이다. anchor box를 사용하면 같은 cell이더라도 여러 object를 찾을 수 있다.

Region proposoal: R-CNN

실제 이미지에서 배경이 공간을 많이 차지한다. 따라서 sliding window detection으로 이미지를 전부 보는것보다 필요한 영역만 보는것이 효과적으로 보일 수 있다. 그 역할을 region proposal이라고 한다.

R-CNN, Fast R-CNN, Faster R-CNN 순으로 모델이 발전했고 selective search를 사용하지 않고 convolution만 사용하여 예측할 수 있게 되었다.\

- R-CNN은 input image에서 selective search 로 RoI를 뽑아 각각 ConvNet에 넣어야해서 많은 cost가 든다.

- Fast R-CNN은 ConvNet을 거친뒤 RoI pooling을 하지만 end-to-end로 진행되지 않는 과정이 한계점이다.

- Faster R-CNN은 region proposal network로 selective search를 대체해 end-to-end로 만들었다.

Semantic segmentation

pixel당 class를 label한다고 생각하면 된다.

Transpose convolution

U-net

U-net은 forward 과정에서 많은 high level 의미정보를 얻지만 반대로 low level 공간정보를 잃게 되는데 skip connection으로 이 차이를 메꿔준다. ResNet에서는 두 정보를 add 해줬다면 U-net에서는 concat 해주고 최종 output은 같은 크기의 이미지에 class 개수만큼의 channel이 나오게 된다.

'Artificial Intelligence > Deep Learning' 카테고리의 다른 글

| [coursera] Sequence Models: Week 1 (0) | 2024.07.03 |

|---|---|

| [coursera] Convolutional Neural Networks: Week 4 (0) | 2024.07.03 |

| [coursera] Convolutional Neural Networks: Week 3-1 (0) | 2024.07.03 |

| [coursera] Convolutional Neural Networks: Week 2 (0) | 2024.07.02 |